Gelecekteki “ChatGPT‑anı” insan benzeri robotlar için en az on yıl ertelenmiştir

Kısaca insan benzeri robotik endüstrisindeki durum

Ne tartışılıyor Kim konuşuyor Ana fikirler Çatallanmanın ortaya çıkma zamanı

Van Xiaogan (Daxiao Robotics), Jensen Huang (Nvidia)

Çatallaşma 2‑3 yıl içinde veri ölçeklendirme ve simülasyonlar sayesinde mümkün.

Shao Hao (Vivo)

Yaklaşık on yıl bekleniyor, ucuz ve çeşitli gerçek veriler ortaya çıkana kadar.

Mevcut durum

Çin geliştiricileri

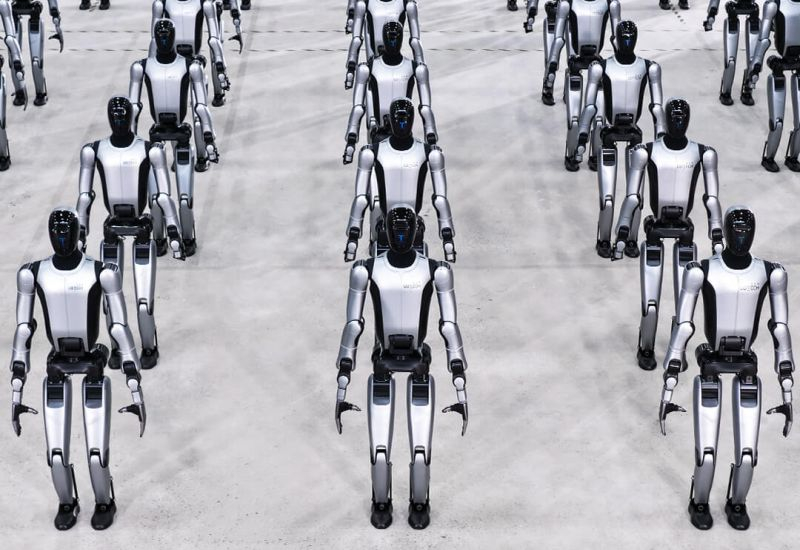

Yeni Yıl konserinde koreografi ve akrobatik gösterisi, ancak hareketler “programlanmış” ve kontrollü ortamda gerçekleştiriliyor.

Kalan sorunlar

Pazarın tüm katılımcıları

1) Ucuz büyük veri setlerine sınırlı erişim;

2) Kinetik sistemlerin istikrarı ve güvenilirliği;

3) Halkın güveni.

Etik ve sosyal konular

Jenny Shipley (eski Yeni Zelanda Başbakanı)

İnsanlar robotlardan duygusal yargılar beklememeli. Fonksiyonlarını düzenlemek, veri güvenliğini sağlamak ve sorumluluğu yönetmek gerekir.

Şu anda neler oluyor

1. ChatGPT’nin etkisi

2022’de modelin açılması IT pazarını ve küresel ekonomiyi değiştirdi. Bu olay, AI’nın ilerleyişi için “nabız” oldu.

2. İnsan benzeri robotlar için öngörüler

- *Van Xiaogan* iki yıl içinde önemli bir ilerleme kaydedilebileceğini, veri hacmini artırarak ve dünya modellerinin simülasyonlarını kullanarak savunuyor.

- *Jensen Huang* öğrenmeyi hızlandırmak için dijital ikizlerin kullanılmasını destekliyor.

- *Shao Hao* tam bir patlama için gerçek verilerin eksikliği nedeniyle yaklaşık on yıl gerektiğini düşünüyor.

3. 2024’teki göstergeler

Çin robotları ulusal konserde akrobatik ve savaş becerilerini sergiledi. Ancak hareketler canlı koreografların kalıplarıyla “programlanmış”tı ve testler statik koşullarda yapıldı.

Ana engeller

Engel Neden önemli? Ucuz veri eksikliği Gerçek gözlemlere sahip olmadan robotlar ev ortamına uyum sağlayamaz. Hareket güvenilirliği İnsanlarla etkileşim için istikrar ve güvenlik kritiktir. Halkın güveni Robotların duygusal kararlar alması korkusunu ortadan kaldırmak için şeffaf düzenleme gerekir.

Kitle uygulamasına nasıl hazırlanmalı

1. Güvenlik standartları – işletme ve bakım kurallarını geliştirin.

2. Sosyal politikalar – serbest bırakılan insan kaynaklarının saygın bir şekilde kullanılmasını sağlayın.

3. Veri koruması – görsel ve ses verilerinin toplanması siber güvenliği tehdit etmemeli.

Düzenleyici örnek

Singapur, AI ajanları için çerçeve kurallarını önerdi; bu robotik için model olabilir. Jenny Shipley yönetim ve sorumluluk dağılımının net bir yapıya ihtiyacı olduğunu vurguluyor: “Şu anda kimin direksiyonun arkasında olduğuna emin değilim.” Bu, yeni teknolojilerin yönetimi ve düzenlemesinde şeffaflığın gerekliliğini gösteriyor.

Sonuç:

ChatGPT’nin çıkışı AI’nın büyük potansiyelini doğruladı. İnsan benzeri robotlar alanında öngörüler 2 ila 10 yıl arasında değişiyor. Şu anda gösterimler etkileyici, ancak pratik uygulama için geniş veri setleri, hareket güvenilirliği ve halkın güveni gerekir; bu sadece güvenlik standartları ve şeffaf düzenleme ile sağlanabilir.

Asted Cloud

Asted Cloud

Yorumlar (0)

Düşüncenizi paylaşın — lütfen kibar olun ve konu dışına çıkmayın.

Yorum yapmak için giriş yapın