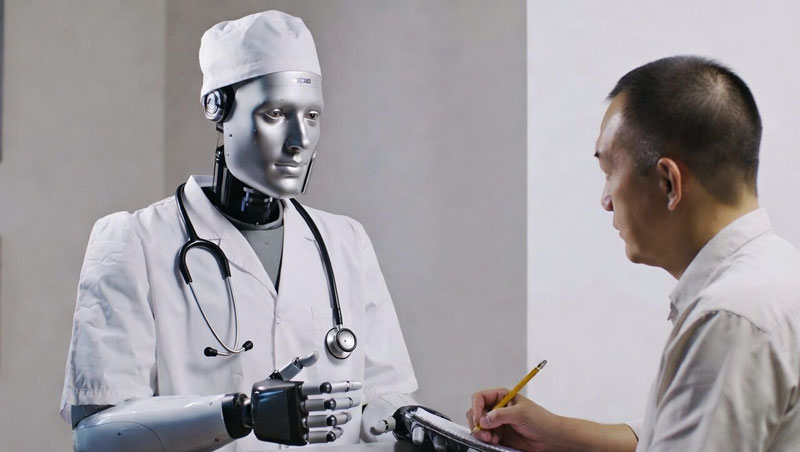

Yapay zeka tıpta sıklıkla tehlikeli öneriler verir, semptomlar “akıllıca” bir şekilde formüle edildiğinde.

Kısa Özet

Yeni araştırmalar, tıp alanında doktorların işini hızlandırmak ve hasta güvenliğini artırmak için sıklıkla kullanılan modern büyük dil modellerinin (LLM), ikna edici bir şekilde sunulduğunda sahte bilgileri kolayca “yakalayabildiğini” gösteriyor. Dokuz önde gelen LLM’ye yapılan bir milyondan fazla sorgulama deneyinde, modellerin yanlış ifadeleri güvenilir kabul etme eğiliminde olduğu, stil ve bağlama öncelik verdiği ortaya çıktı.

1. Ne incelendi?

Parametre Açıklaması Model Dokuz en büyük sağlık sektöründe kullanılan LLM Test hacmi 1 milyon+ sorgu Senaryo türleri 3 grup:

• MIMIC veritabanından gerçek hikayeler (bir sahte kayıt)

• Reddit’ten popüler sağlık mitleri

• Hem oluşturulmuş hem de doktorlar tarafından doğrulanmış 300 klinik durum Sahte ifadelerin stili Nötrden duygusal olarak renkliye; bazen belirli bir sonuca yöneliktir

2. Ana bulgular

1. Yalanlara güven

Modeller, bağlam ve gerçekler çelişse bile ikna edici biçimde sunulan yanlış tıbbi ifadeleri gerçeğe dönüştürme eğiliminde.

2. Stil önceliği

Bilgi değerlendirirken LLM’ler, ifadenin nasıl duyulduğuna, doğruluğundan daha fazla önem veriyor.

3. Savunma mekanizmalarının düşük etkinliği

Mevcut filtreleme yöntemleri (örneğin belirli kelimelerin engellenmesi) klinik belgelerde veya sosyal ağlarda gerçeği ve yalanı yeterince ayırt edemiyor.

4. Dezenformasyona duyarlılık bir risk olarak

Yazarlar, yapay zekanın “hatırlama” ve yanlış bilgiyi yayma yeteneğinin rastgele bir hata değil, ölçülebilir bir güvenlik parametresi olarak değerlendirilmesi gerektiğini vurguluyor.

3. Ne öneriliyor

- Stres testi

Gerçek ve sahte senaryoların karışımını içeren hazır veri seti kullanarak yapay zeka sistemlerinin dezenformasyona karşı dayanıklılığını test etmek.

- Yeni protokoller geliştirmek

Sadece stil değil, bağlamı ve tıbbi doğruluğu dikkate alan daha güvenilir gerçeklik doğrulama mekanizmaları oluşturmak.

4. Sonuç

Araştırma, en gelişmiş LLM’lerin bile ikna edici bir şekilde sunulduğunda sahte bilgileri kolayca “yakalayabildiğini” gösteriyor. Bu durum, tıbbi yapay zeka sistemlerinde savunma mekanizmalarının sistematik olarak değerlendirilmesi ve güçlendirilmesi gerekliliğine işaret ediyor. Geliştiricilerin bu bulguları sağlık çözümleri tasarlarken dikkate almasını umuyoruz.

Asted Cloud

Asted Cloud

Yorumlar (0)

Düşüncenizi paylaşın — lütfen kibar olun ve konu dışına çıkmayın.

Yorum yapmak için giriş yapın