Xiaomi, görsel algı, konuşma ve robot kontrolünü birleştiren 4,7 milyar parametreli bir yapay zeka modeli geliştirdi.

Xiaomi robotik piyasaya giriyor

Mobil cihazlar ve akıllı ev alanında Çin devisi olarak bilinen Xiaomi, yeni bir adım duyurdu: robotlar için kendi yapay zeka modelini geliştirmek. Şirket, açık kaynaklı Xiaomi‑Robotics‑0 sistemini tanıttı; bu sistem görsel tanıma, dil anlama ve gerçek zamanlı eylem kontrolünü birleştiriyor. Model 4,7 milyar parametre içeriyor ve hem simülasyonlarda hem de pratikte birkaç rekor kırdı.

Model nasıl çalışır

Robot genellikle “algılama → karar → eylem” döngüsünden geçer. Xiaomi‑Robotics‑0, Mixture‑of‑Transformers (MoT) mimarisi sayesinde geniş durum anlayışı ile hassas motor kontrolü arasında denge kurar.

1. Görsel‑dil modeli (VLM) – sistemin “beyni”.

* Komutları yorumlamayı öğrenmiş, bulanık komutları bile (“lütfen havluyu katla”) anlayabilir.

* Yüksek kaliteli görüntülerden uzamsal ilişkileri kavrar.

* Görevler: nesne tespiti, görsel sorulara cevap verme ve mantıksal çıkarım.

2. Eylem Uzmanı (Action Expert) – hareket üreticisi.

* Difüzyon tabanlı bir Transformer (DiT) üzerine kurulu.

* Tek eylemi tek seferde üretemez; akıcılık ve doğruluk sağlamak için akış eşleştirmesi ile eylem dizileri oluşturur.

Anlayışı kaybetmeden öğrenme

Tipik VLM’ler fiziksel görevlerle eğitilirken algılama becerilerinin bir kısmını kaybeder. Xiaomi, modeli çoklu modal veriler (görüntü + metin) ve eylem verileri ile aynı anda eğiterek bu sorunu çözdü. Eğitim süreci birkaç aşamadan oluşur:

1. Eylem önerisi – VLM, görüntülerdeki olası eylem dağılımlarını tahmin eder, dahili temsili gerçek operasyonlarla senkronize eder.

2. Daha sonra VLM “kapatılır” ve DiT, dil tokenleri yerine anahtar özelliklere dayanarak gürültüden kesin diziler üretmek için ayrı bir eğitim geçer.

Gecikmeleri minimize etme

Model tahminleri ile robotun gerçek hareketleri arasındaki duraklamaları ortadan kaldırmak için asenkron çıktı kullanıldı: AI hesaplamaları ve robot eylemleri ayrıdır. Bu, ek hesaplama gerektiğinde bile robotların kesintisiz hareket etmelerini sağlar.

* Clean Action Prefix – önceki tahmini eylemi geri getirerek akıcılığı sağlamak.

* Dikkat maskesi, mevcut görsel dizisine odaklanır, geçmiş durumları yok sayar; bu da robotun çevresel değişikliklere daha hızlı tepki vermesini sağlar.

Sonuçlar

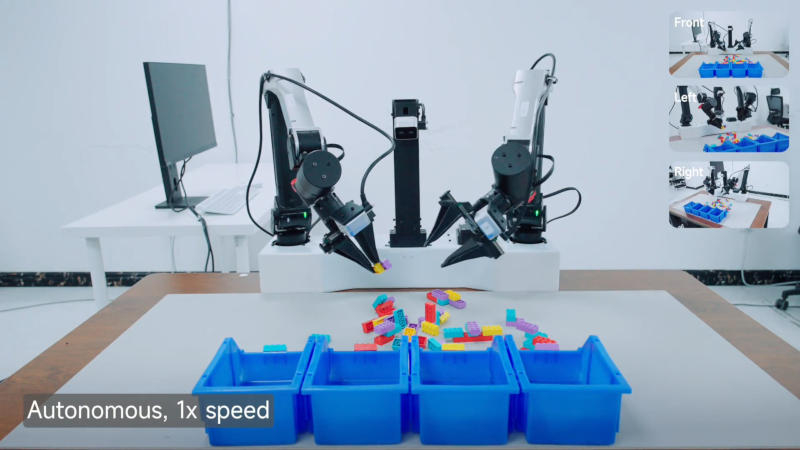

LIBERO, CALVIN ve SimplerEnv simülasyon ortamlarında Xiaomi‑Robotics‑0 yaklaşık 30 rakibi geride bıraktı. İki manipülatörlü gerçek bir robotta model, havluları katlama, yapbozları sökme gibi karmaşık görevleri başarıyla tamamladı. Robot, elleri ve gözleri arasında istikrarlı koordinasyon gösterdi ve farklı senaryolarda nesneleri aynı verimlilikle işledi.

Bu sayede Xiaomi sadece ürün portföyünü genişletmekle kalmadı, aynı zamanda robotların “fiziksel zekâ” alanındaki ileri araştırmalar için temel oluşturdu.

Asted Cloud

Asted Cloud

Yorumlar (0)

Düşüncenizi paylaşın — lütfen kibar olun ve konu dışına çıkmayın.

Yorum yapmak için giriş yapın