Nvidia, AI modellerinin token seviyesinde çıkarımını hızlandıran Groq 3 LPU çipini çıkardı

Nvidia, Vera Rubin platformunun yeni özelliklerini açıklıyor

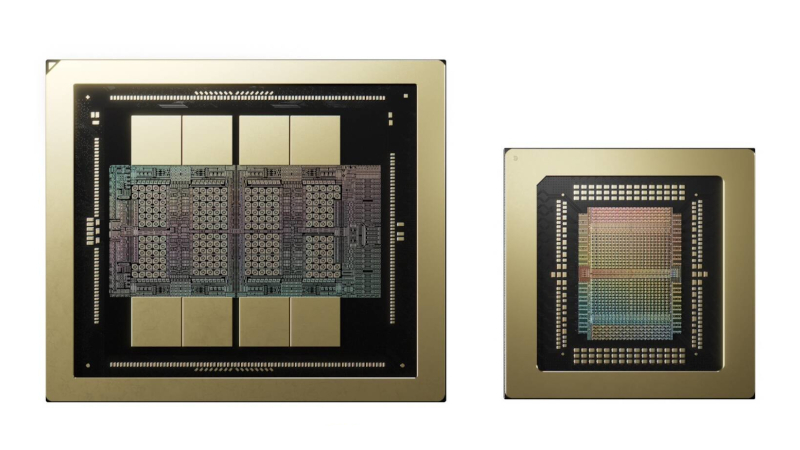

Bu yılki GTC konferansında Nvidia CEO’su Jensen Huang, Vera Rubin platformunu genişletmeyi duyurdu. Yeni özelliklerin temelini, Groq şirketinden satın alınan fikri mülkiyet oluşturuyor ve Rubin’a *Groq 3 LPU* çipi eklendi – yüksek hızda ve düşük gecikmeli token üretimi için tasarlanmış bir inference hızlandırıcısı.

Vera Rubin’de zaten bulunanlar

Platform, Nvidia’nın tek başına sistemler halinde topladığı ve büyük AI fabrikalarına ölçeklendirdiği altı ana bileşenden oluşur:

| Bileşen | Açıklama |

|---|---|

| GPU Rubin | 288 GB HBM4'lü grafik kartı |

| CPU Vera | Merkezi işlemci |

| NVLink 6 | Sistem içi ölçekleme sistemi |

| ConnectX‑9 | Akıllı ağ adaptörü |

| BlueField‑4 | Veri işleme işlemcisi |

| Spectrum‑X | Entegre optikli sistemler arası ölçekleme anahtarı |

Groq 3 LPU, büyük sistemlerin dağıtımında kullanılacak yeni bir yapı bloğu olarak eklenmiştir.

Groq 3 LPU’nun öne çıkan yönü

Ana fark bellek mimarisi. Çoğu hızlandırıcı çalışma belleği olarak HBM kullanırken, her Groq 3 LPU 500 MB SRAM içerir. Karşılaştırma:

| Parametre | GPU Rubin (HBM4) | Groq 3 LPU (SRAM) |

|---|---|---|

| Kapasite | 288 GB | 0,5 GB |

| Bant Genişliği | ~22 TB/s | 150 TB/s |

Inference görevleri için bant genişliğine duyarlı olduğunda SRAM avantajı belirgindir. Bu nedenle Nvidia, token üretim hızını artırmak için Groq 3'ü Rubin’a dahil etti.

Groq 3 LPX Racks

Rack içinde 256 adet Groq 3 LPU çipi bulunur, bu da sağlar:

- 128 GB SRAM

- Toplamda 40 PB/s bant genişliği

- Sistem içi arayüzde 640 TB/s

Hyper‑scalable çözümler başkanı Ian Buck, bu rack’i Rubin için bir süperişlemci olarak tanımladı ve modelin her katmanında ve tokeninde kodlama performansını artırmadaki rolünü vurguladı.

Çoklu ajan sistemleri üzerindeki etkisi

Buck, Groq 3 LPX’in gelecekteki AI pazarının çoklu ajan sistemleri için kritik bir bileşen olacağını belirtti. Ajanlar doğrudan veri alışverişi yaptığında ve sohbet botları üzerinden geçmediğinde, yanıt gereksinimleri değişir: 100 token/s'den 1 500+ token/s'ye kadar.

Rakipler ve perspektifler

Metinde, Wafer‑Scale Engine (WSE) ile büyük SRAM kullanan Cerebras adlı bir rakip adı geçen. OpenAI, düşük gecikmeli inference için avantajlı gecikmesi sayesinde Cerebras’ı ileri modellerinde kullanıyor.

Buck ayrıca Groq 3 LPU’nun ortaya çıkmasının Rubin CPX hızlandırıcısına bağımlılığı azaltabileceğini belirtti. Nvidia şu anda Groq 3 LPX rack'ini platformla entegre etmeye odaklanırken, her iki çip de büyük GDDR7 bellek hacmine ihtiyaç duymadan inference’ı güçlendirmeyi hedefliyor.

Sonuç:

Yeni Groq 3 LPU çipi ve LPX rack’i, Vera Rubin’i düşük gecikmeli inference alanında güçlendiriyor, daha hızlı çoklu ajan AI sistemlerine yol açıyor ve Cerebras gibi oyuncularla rekabet ediyor.

Asted Cloud

Asted Cloud

Yorumlar (0)

Düşüncenizi paylaşın — lütfen kibar olun ve konu dışına çıkmayın.

Yorum yapmak için giriş yapın